В отношении Tesla регуляторными органами США инициировано очередное расследование. На этот раз, на первый взгляд, все серьезно: система машинного зрения на электрокарах иногда воспринимает за угрозу безопасные или вовсе несуществующие объекты. Разбираемся, «прикроют ли лавочку» Илона Маска теперь.

Сама история с «фантомными торможениями», как их окрестили владельцы электромобилей Tesla не нова. Многие обладатели навороченных машин от компании Илона Маска (Elon Musk) хотя бы раз за время эксплуатации сталкивались с подобным явлением. Суть в том, что искусственный интеллект воспринимает незначительные раздражители — вроде мусора на дороге или автомобиля на полосе встречного движения, — за угрозу. И действует логичным образом: активирует тормоза.

Иногда это просто снижение скорости движения на несколько километров в час, реже — почти полная остановка. Но общая частота подобных событий никогда не была сколь-нибудь большой. Точной статистики нет, но судя даже по самым эмоциональным и негативным сообщениям в социальных сетях, «фантомные торможения» встречались едва ли чаще одного случая на несколько десятков тысяч миль. Что самое важное — еще ни разу это поведение ИИ в электрокарах Tesla не привело к аварии (иначе регуляторы заинтересовались бы феноменом гораздо раньше) за семь лет активной эксплуатации на дорогах общего пользования.

Ситуация радикально поменялась после того, как инженеры Tesla окончательно отказались от использования радаров в качестве «органов чувств» для «автопилота». С мая 2021 года все новые электромобили этого производителя получают информацию об окружающей действительности аналогично людям — с помощью зрения. Только машинного, да и глаз в четыре раза больше, чем у человека. Технология называется Tesla Vision и по заявлениям компании обеспечивает тот же уровень безопасности, что и радар. К слову, лидаров (лазерных радаров) — наиболее надежных, но и дорогих при этом органов чувств для ИИ, — на серийных электрокарах от Илона Маска не было никогда (хотя испытания проводились).Результат нового подхода не заставил себя ждать, обнаружились как плюсы, так и минусы. С одной стороны работающие на основе только одного типа входящей информации нейросети явно стало проще усовершенствовать: уже в прошлом июле очередное обновление ПО привнесло в «автопилот» улучшенную ориентацию при ограниченной видимости на дороге, а также «понимание» сигналов поворота на других машинах. Тем не менее, участились и досадные ошибки — чего стоит только история с Луной, которую машинное зрение Tesla принимало за желтый сигнал светофора.

Теперь обстановка радикально ухудшилась. С прошлой осени сообщения о «фантомном торможении» стали появляться гораздо чаще. Портал Electrek даже выпустил об этом собственный отчет на основе множества записей в открытых источниках. Но его почти никто не заметил. А вот в начале февраля 2022 года феномен заметил такой мастодонт среди СМИ, как The Washington Post. Сотрудники этого издания явно не стеснялись в выражениях и нагнетании драмы. Если читать текст не вдумываясь, складывалось ощущение, что едва ли не каждая первая Tesla так и норовит поймать в свою корму сзади едущее транспортное средство при любом удобном случае.

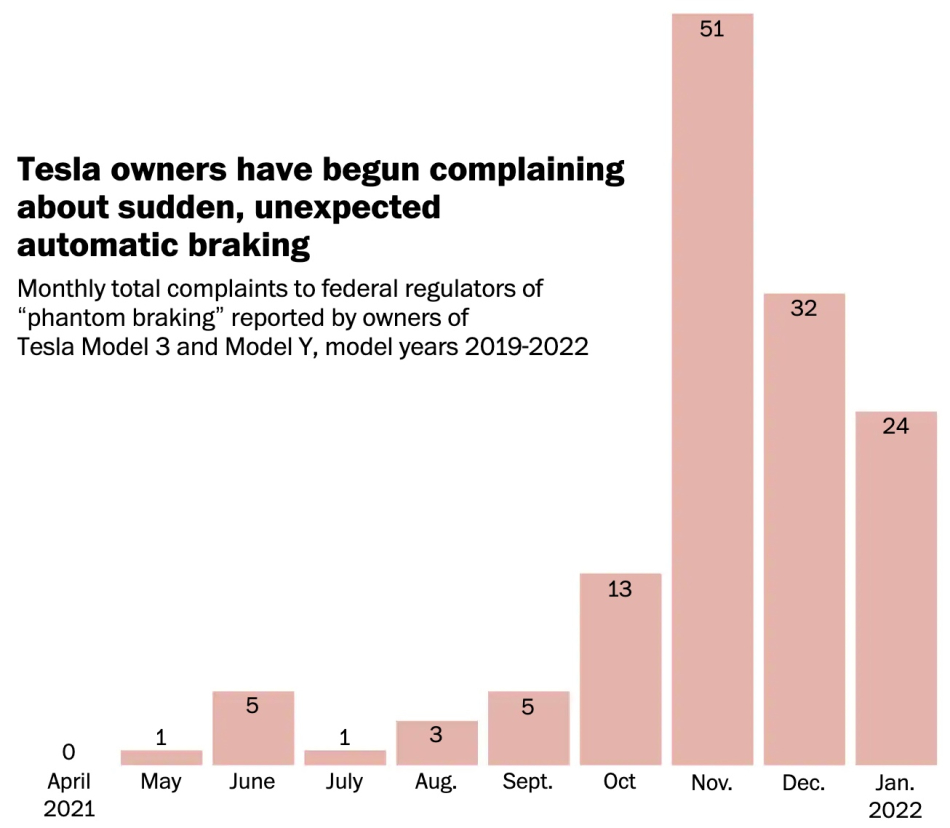

К счастью, о журналистской этике авторы той статьи все же не забыли. Поэтому привели сухие цифры, ставшие результатом своего анализа: с мая 2021-го по январь 2022-го всего удалось зафиксировать 135 сообщений о «фантомных торможениях» (все на Model 3 и Y 2019-2022 модельных годов), 107 из которых пришлись на последние три месяца. Для понимания серьезности ситуации — всего в США за прошлые два года было продано чуть менее 600 000 электрокаров Tesla. Компания не дает разбивки по моделям в регионах, но портал InsideEVs оценивает долю Model 3 и Y в 93% от общего числа отгрузок. Тем не менее, Национальное управление безопасностью движения на трассах США (NHTSA) инициировало полномасштабное расследование, нельзя же игнорировать обеспокоенных проблемой американцев.

Мнение регулятора

Ресурс Electrek вчера запросил в NHTSA комментарии по поводу разбирательства, регулятор ответил следующее. Во-первых, ведомство располагает несколько иной статистикой — в него обратилось 354 человека с жалобами на «фантомные торможения». Во-вторых, производитель сотрудничает с Управлением и оказывает полную поддержку. Все необходимые данные предоставляются, запросы получают ответы, а диалог идет на спокойных тонах. Наконец, в-третьих, пока ни о каких требованиях запустить отзывную кампанию или вообще запретах на эксплуатацию речи и близко не идет.

Казалось бы, фанатам Илона Маска можно вздохнуть с облегчением. Но не все так просто.

Опасная проблема или очередной повод для негатива в сторону Tesla?

Любая компания, работающая на острие прогресса, рано или поздно начинает расплачиваться за свои инновации. Речь, естественно, не о деньгах. Автомобильная вотчина эксцентричного миллиардера с момента своего основания всячески продвигает идею «автопилота». Чтобы постоянно развиваться и опережать конкурентов Tesla внедряет в свои электрокары гораздо более продвинутые системы, чем обычные интеллектуальные помощники водителя (ADAS).

Да, номинально, и Autopilot и Full Self-Driving — просто наборы технологий, аналогичных «общепринятым» ассистентам в «обычных» машинах. Среди них и удержание в полосе, и адаптивный круиз-контроль, и помощник при парковке. Однако даже описание самих функций уже содержит намеки, что не все так просто. Круиз-контроль умеет самостоятельно перестраиваться между рядами (и делал это задолго до похожих решений конкурентов), а также ведет электромобиль не просто по дороге, а согласно проложенному по карте маршруту. Про всякие «призывы» (Summon) машины на парковке даже и говорить не надо — даже в «сыром» состоянии эта опция взрывает мозг.

А если открыть браузер и в строке поиска набрать что-нибудь вроде «Tesla avoids collision», ворох шокирующих видео не заставит себя ждать. На третьем или, в крайнем случае десятом примере легко встречается ситуация, которую не смог бы без потерь отработать любой другой ADAS или даже опытный человек. Иными словами, созданные Tesla технологии только маскируются под помощников, на деле они — полноценный автопилот третьего уровня. И несмотря на все прописанные в инструкциях ограничения, люди беспардонно пользуются этим, хотя законодательной базы, регулирующей подобные инновации. В этом и беда — бюрократы давно ищут любую зацепку, которая может помочь им прижать к ногтю «улетевшую в технократический угар» компанию.

«Фантомные торможения» имеют все шансы стать таким козырем. За последние годы Tesla уже не раз становилась целью для расследований регуляторов из разных стран. Но до сих пор никто не смог однозначно связать «автопилот» не то что с аварией, хотя бы с опасной ситуацией на дороге. А проблема с неадекватной реакций ИИ на окружающую обстановку выглядит системной, то есть не связанной с отдельными подпрограммами электрокара.

Беда именно в Tesla Vision, нейросети которого будто перетренировали, поэтому теперь они дают слишком много ложноположительных результатов. Лишним подтверждением этой мысли служит тот факт, что количество сообщений о «фантомных торможениях» резко выросло после очередного обновления ПО электромобилей в начале прошлой осени. И стало снижаться в течение последующих месяцев, когда компания выпустила несколько патчей.

Все свидетельства о феномене «фантомных торможений» выглядят очень по-разному и какого-то единого принципа вычленить из них не получается. Одни гласят, что электромобиль затормозил перед пролетающим на ветру пакетом, другие описывают срабатывание тормозной системы на совершенно пустой дороге. Кто-то пишет, что порой машина постоянно подтормаживает на протяжении всей поездки по хайвею, другое сообщение описывает единичные срабатывания на глухих проселках со следами асфальта вместо покрытия.

Гадать на кофейной гуще не будем, исход совершенно не ясен — ни одна сторона даже не поделилась подробной статистикой. А для определения серьезности проблемы нужно, как минимум, знать при каких условиях и как часто «фантомные торможения» вызывают полную остановку (как функция экстренного торможения). Если большинство случаев — это просто небольшое замедление, то ситуация выглядит совсем уж надуманной. На данный момент известно лишь три твердых факта:

- ни одной аварии из-за феномена не произошло;

- само явление существует, но проявляется с нерегулярной частотой (и сейчас становится реже);

- расследование идет, его результаты будут не скоро.

21

21

Комментарий отправлен

Ваш комментарий опубликован.

Провокационные или оскорбительные комментарии запрещены.